- 回首頁

- 機械工業雜誌

- 當期雜誌

摘要:智慧化製造是目前產業升級一大主軸,可細分為感知智慧化與運動智慧化,就如同人眼獲得影像,大腦辨識影像內容感知環境資訊,小腦迅速協調人手做出反應動作,當中各個環節缺一不可。近年來人工智慧快速發展演進推升影像辨識智慧化,運動智慧化同樣需要相應配合才能完成整個智慧化閉環,如何配合辨識結果做出高速且精準的動作,就是我們要面臨的課題,本文將以整合塑膠資源回收分選產線的案例為引子,介紹如何以工研院機械所開發的EtherCAT運動控制平台(EMP)為基底,開發一套能與影像辨識系統即時協作的機器人控制器。

Abstract:Intelligent manufacturing is a major axis of current industrial upgrading, which can be subdivided into perception intelligence and motion intelligence. Just like the human eye obtains images, the brain recognizes the image content and perceives environmental information, and the cerebellum quickly coordinates the human hand to respond, all aspects are indispensable. In recent years, the rapid development of artificial intelligence has improved the image recognition, and the motion intelligence also requires corresponding cooperation to complete the entire intelligent closed-loop. This article will take the case of integrating plastic resource recycling and sorting production line as an introduction, and introduce how to develop a robot controller that can cooperate with the image recognition system based on the EtherCAT Motion Control Platform (EMP) developed by the Mechanical and Mechatronics Systems Research Labs in ITRI.

關鍵詞:人工智慧、機器人、EtherCAT運動控制平台

Keywords:Artificial intelligence, Robot, EtherCAT motion control platform

前言

取放物件是工業生產上機械手臂的主流應用之一,該應用方向得利於近年來機械智動化的提升,其應用情境得以越加複雜、寬廣。舉例而言,早期的手臂取放動作相對固定,首先要限制物件擺放在輸送帶上的位置,其後輸送帶移動到設定好的定點後停下,再等待手臂至此定點夾取,這種方法容易實現,但缺點也顯而易見,包含物件擺放必須嚴格整齊、無法確定前一站物件確實擺放妥當、以及輸送帶花費時間啟停拖慢產線流程等等,此種應用通常只需以可程式化邏輯控制器(Programmable Logic Controller, PLC)作為上位控制就可以完成任務;其後很快地就有配合光遮斷器用以感應物件擺放位置的方案,前一站物件擺放精度得以放寬,又可感測擺放成功與否,手臂不至在無物件的輸送帶上空取,如果加上輸送帶位置控制與手臂相配合,手臂追隨輸送帶座標後則不需要等待輸送帶啟停,取放速度又得到進一步提升,此輸送帶追隨功能又是一個運動控制進步。接著是二維影像辨識的加入,相較於光遮斷器僅能補償平行於輸送帶行進方向,影像不僅可以得知物件擺放的二維偏移量,還可計算其旋轉量,物件不堆疊的情況下,這三種偏移量都可用選擇順應性裝配機械手臂(Selective Compliance Assembly Robot Arm, SCARA)處理;最後則是處理任意堆疊的物件,相同的物件放在料件箱中以不規則的方式立體堆疊著,比起攝影機資訊僅能處理平面上的平移與旋轉這3個自由度,在整個三維空間上的平移旋轉有6個自由度之多,要先有立體感測能獲得三維點雲資訊,從中識別出目標料件的堆疊位置與角度,再計算出手臂的夾取角度與路徑,為了增加自由度,通常手臂也由SCARA換為更複雜的六軸關節手臂。至此,一般工廠產線中各種取放疑難雜症就已幾乎攻克完畢。

近年來深度學習的興起又向人工智慧與影像辨識注入了一股活水,識別物件的準確度不僅有機會超越人類,其推論速度在演算法與GPU平行運算加速之下還能做到線上處理。如今影像辨識能處理的對象就不再只是針對工廠生產線某個固定種類的產品了,跳出此一框架能想到的應用場景可謂五花八門,例如本文將介紹的案例,就是一個結合深度學習影像識別與手臂控制的即時處理情境。這個案例是要在現有的塑膠回收分選產線上,以自動化系統解決其人力緊張問題,因此要夾取的對象不只種類多元、大小不一,同類物品之間也有不同程度的擠壓扭曲等變形,擺放在輸送帶上也免不了各種位置偏移、角度旋轉與交互堆疊,因此其取放與影像識別同樣具有挑戰性。在影像辨識方面解決方案為YOLO(You Only Look Once)演算法,在大量收集數據標記物件並訓練模型微調參數之後,辨識結果已有一定成效,但使用該開源工具並非本文的重點與創新之處,故不特作介紹,本文主要將介紹如何整合非即時系統下取得的影像辨識結果與運動控制達到即時取放的效果。

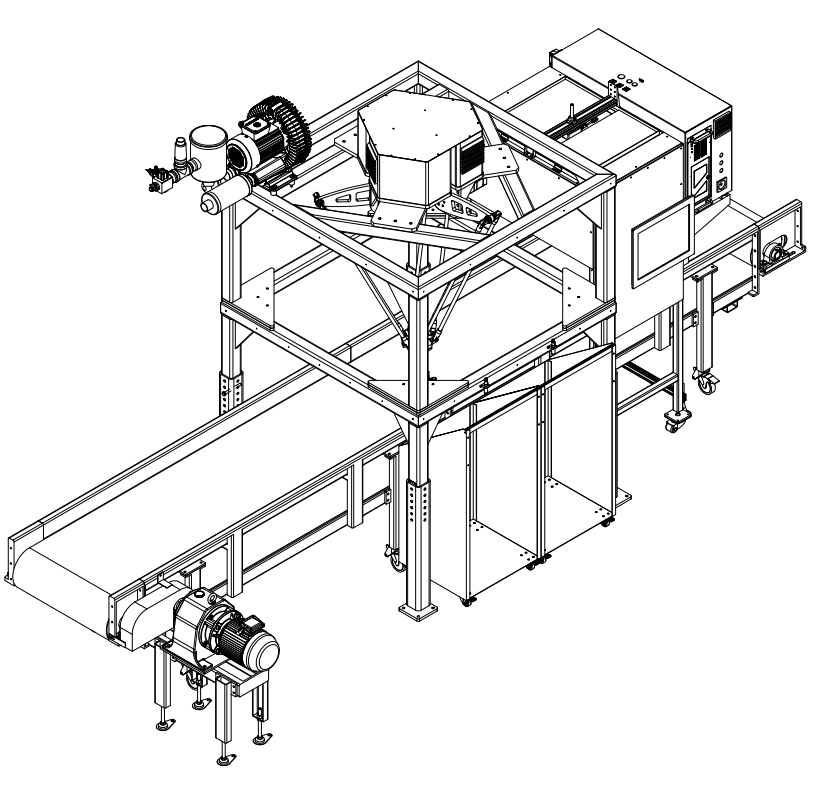

本文分享案例稱為人工智慧塑膠資源分類系統,其硬體是由取像模組、並聯式機器手臂、Delta手臂控制器、輸送帶編碼器與吸嘴系統所構成,圖1為各硬體的安裝完成後的示意圖。

圖1 AI塑膠資源分類系統硬體配置圖

更完整的內容歡迎訂購 2022年09月號 (單篇費用:參考材化所定價)

主推方案

無限下載/年 5000元

NT$5,000元

訂閱送出